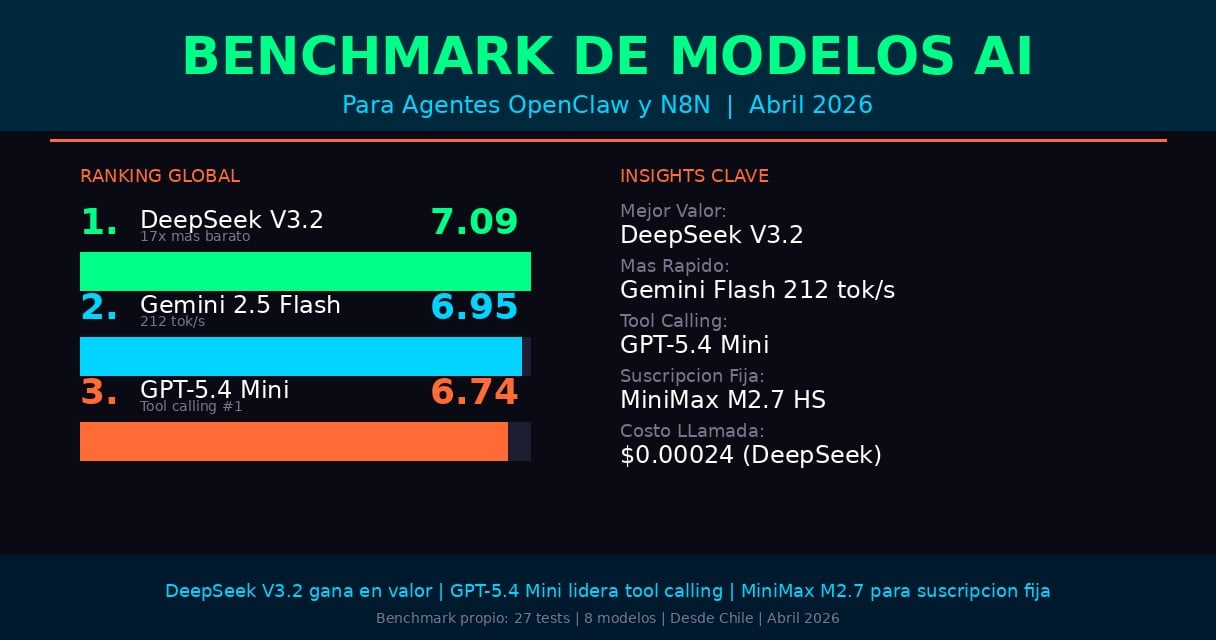

Benchmark de Modelos AI para Agentes (OpenClaw, N8N) — Abril 2026

Después de ejecutar 27 tests con 8 modelos diferentes desde Chile, los resultados son claros: DeepSeek V3.2 gana en valor absoluto, pero MiniMax M2.7 es la mejor opción para agentes con suscripción fija.

Los Resultados que Importan

He probado 8 modelos durante 2 semanas ejecutando benchmarks completos de contenido, tool calling, coding, reasoning y gestión de tareas. Los tests se ejecutaron desde Chile con latencia real de conexión a cada proveedor.

Ranking Global — 27 Tests por Modelo

| # | Modelo | Score | Velocidad | Latencia | Costo/Call | Tipo |

| 1 | DeepSeek V3.2 | 7.09 | 36 tok/s | 18.8s | $0.00024 | Open Source (MIT) |

| 2 | Gemini 2.5 Flash Lite | 6.95 | 212 tok/s | 4.7s | $0.00362 | Propietario |

| 3 | GPT-5.4 Mini | 6.74 | 142 tok/s | 6.4s | $0.00316 | Propietario |

| 4 | MiniMax M2.7 Highspeed | 6.74 | 51 tok/s | 26.1s | $0.00421 | Parcial |

| 5 | Claude Sonnet 4.6 | 6.70 | 62 tok/s | 21.1s | $0.00415 | Propietario |

| 6 | MiniMax M2.7 | 6.68 | 57 tok/s | 26.5s | $0.00431 | Parcial |

| 7 | GPT-5.4 | 6.25 | 65 tok/s | 14.8s | $0.00320 | Propietario |

| 8 | Qwen 3.6 Plus | 6.07 | 47 tok/s | 83.1s | $0.00995 | Open Source (Apache) |

Costo/Call = lo que cuesta procesar una request típica de benchmark (input + output). Con 100 requests/day, DeepSeek cuesta ~$0.024/día vs Claude Sonnet ~$0.42/día.

🚀 ¿Te interesa la tecnología que realmente importa?

En la comunidad compartimos herramientas, workflows y automatizaciones que usamos en el día a día. Sin teoría — pura práctica.

👥 Entrar a la comunidad

Recomendación para Agentes OpenClaw y N8N

Por Caso de Uso

| Uso | Modelo Recomendado | Por Qué |

| Agente con tool calling (N8N) | GPT-5.4 Mini | #1 en tool calling (7.5/10), rápido, económico |

| Agente económico | DeepSeek V3.2 | #1 global, 17x más barato que Claude |

| Agente ultra-rápido | Gemini 2.5 Flash Lite | 212 tok/s, 4.7s latencia |

| Agente con suscripción fija | MiniMax M2.7 | $20-69/mes, sin sorpresas de costo |

| Contenido para startups | DeepSeek V3.2 | #1 en startup content |

| Feature images WordPress | MiniMax Image-01 | 5/5 exitosos, 16-60s por imagen |

Por Suscripción

Si ya tienes una suscripción fija, esta es la mejor opción por tier:

| Tier | Suscripción | Mejor Modelo | Score Global |

| Gratis | Qwen 3.6 Plus Preview | $0/M | 6.07 |

| $10-20/mes | MiniMax Coding Plan | M2.7 Highspeed | 6.74 |

| $20/mes | Google AI Pro | Gemini 2.5 Flash Lite | 6.95 |

| $50/mes | Qwen Coding Pro | Qwen 3.6 Plus | 6.07 |

| $69/mes | MiniMax Agent Pro | M2.7 Highspeed | 6.74 |

Los Hallazgos Clave

1. DeepSeek V3.2 es el Rey del Valor

Con un score de 7.09 y un costo de $0.00024 por request, DeepSeek V3.2 es 17x más barato que Claude Sonnet para resultados ligeramente mejores. Si el presupuesto es una variable, esta es la respuesta.

DeepSeek V3.2: Score 7.09 | $0.00024/req | 36 tok/s | 18.8s latencia

Claude Sonnet 4: Score 6.70 | $0.00415/req | 62 tok/s | 21.1s latenciaDeepSeek es mejor Y más barato. La única desventaja: latencia variable cuando hay alta demanda global.

2. GPT-5.4 Mini le Gana al GPT-5.4 Grande

Este fue sorprendente. GPT-5.4 Mini (versión compacta) superó al GPT-5.4 normal en todas las categorías y es más rápido.

GPT-5.4 Mini: Score 6.74 | 142 tok/s | 6.4s latencia | $0.00316/req

GPT-5.4: Score 6.25 | 65 tok/s | 14.8s latencia | $0.00320/reqSi usas GPT-4o o GPT-5.x, cambia a la versión Mini ahora.

3. Gemini 2.5 Flash Lite es el Más Rápido

Con 212 tokens/segundo y solo 4.7 segundos de latencia, Gemini 2.5 Flash Lite es el modelo más rápido de esta prueba — 30x más rápido que Claude Sonnet.

Para tareas donde la velocidad importa más que la profundidad (moderación, clasificación, herramientas de baja latencia), este es el modelo.

4. MiniMax M2.7 es el Mejor para Suscripciones Fijas

Si no quieres sorpresas en la factura y prefieres pagar una cantidad fija mensual, MiniMax M2.7 Highspeed ofrece:

- Score 6.74 (tercer lugar global)

- $20-69/mes sin límite de requests

- Tool calling excelente (SOTA para su tier de precio)

- Imagen y audio integrados (Image-01, Speech-02)

La suscripción de MiniMax es la única que incluye generación de imágenes y voz sin costo adicional.

5. Claude Ya No Justifica el Costo

Claude Sonnet 4.6 scored 6.70 — menos que DeepSeek V3.2 (7.09), Gemini Flash Lite (6.95), y GPT-5.4 Mini (6.74) — mientras cuesta:

- $0.00415/req (17x más caro que DeepSeek)

- 21.1 segundos de latencia

- Sin suscripción API barata (Anthropic no ofrece una)

Si Anthropic no lanza un plan de $20/mes con API, va a perder mercado rápidamente frente a Google y DeepSeek.

Qué Modelos Uso Yo (Después del Benchmark)

Después de vender Pago Fácil y dedicarme a invertir y mentoriar startups, automatiqué casi todo mi trabajo con agentes de IA. Esta es mi configuración actual:

- OpenClaw (mi asistente personal): MiniMax M2.7 Highspeed — suscripción fija, funciona 24/7, sin sorpresas

- N8N (automatizaciones): DeepSeek V3.2 — para workflows que requieren razonamiento

- Contenido rápido (resúmenes, emails): Gemini 2.5 Flash Lite — velocidad > profundidad

No uso Claude para nada de esto. Y lo digo después de haber sido suscriptor de $200/mes. El mercado cambió.

Comparativa de Velocidad (tokens/segundo)

| Modelo | tok/s | Tiempo para 1000 tokens |

| Gemini 2.5 Flash Lite | 212 | 4.7s |

| GPT-5.4 Mini | 142 | 7.0s |

| GPT-5.4 | 65 | 15.4s |

| Claude Sonnet 4.6 | 62 | 16.1s |

| MiniMax M2.7 HS | 51 | 19.6s |

| MiniMax M2.7 | 57 | 17.5s |

| DeepSeek V3.2 | 36 | 27.8s |

| Qwen 3.6 Plus | 47 | 21.3s |

Cómo Configurar Cada Modelo en OpenClaw

DeepSeek V3.2 (Mejor Valor)

{

"models": {

"providers": {

"deepseek": {

"baseUrl": "https://api.deepseek.com/v1",

"apiKey": "tu_api_key",

"api": "openai-completions",

"models": [

{"id": "deepseek-chat/deepseek-v3-250324"}

]

}

}

}

}MiniMax M2.7 Highspeed (Mejor Suscripción Fija)

{

"models": {

"providers": {

"minimax": {

"baseUrl": "https://api.minimax.io/v1",

"apiKey": "tu_api_key",

"api": "openai-completions",

"models": [

{"id": "MiniMax-M2.7-highspeed"}

]

}

}

}

}Gemini 2.5 Flash Lite (Más Rápido)

{

"models": {

"providers": {

"gemini": {

"baseUrl": "https://generativelanguage.googleapis.com/v1beta/openai/",

"apiKey": "tu_api_key",

"api": "openai-completions",

"models": [

{"id": "gemini-2.0-flash-lite"}

]

}

}

}

}Los Packs: Qué Suscripción Obtener y Para Qué

Después de mi experiencia configurando agentes para más de 100 emprendedores en programas de aceleración, estos son los packs que realmente funcionan:

Pack 1: MiniMax ($10-$69/mes) — Mejor para Agentes 24/7

| Plan | Precio | Modelo | Para qué |

| Agent Pro | $19/mes | M2.7 | Agentes N8N/OpenClaw |

| Agent Pro+ | $69/mes | M2.7 | Agentes 24/7 sin límites |

Incluye: Tool calling SOTA, generación de imágenes (Image-01) y audio (Speech-02) sin costo adicional.

Mi recomendación: Agent Pro ($19/mes) + fallback a DeepSeek V3.2 cuando MiniMax tiene alta demanda.

Pack 2: Google AI ($20/mes) — Mejor para Velocidad

| Plan | Precio | Modelo | Para qué |

| AI Pro | $19.99/mes | Gemini 2.5 Pro | Calidad + velocidad |

| Gemini 2.5 Flash | API | $0.30/M | Cuando necesitas velocidad |

Incluye: Contexto de 1M tokens, integrado en Google Workspace (Gmail, Docs).

Pack 3: DeepSeek + OpenRouter — Mejor Valor

| Plan | Precio | Modelo | Para qué |

| Pay-as-you-go | $0.14/M input | DeepSeek V3.2 | Razonamiento, contenido |

| Free tier | $0 | 27 modelos | Probar sin costo |

Mi recomendación: Una cuenta en OpenRouter con $5-10 de crédito = 1 año de agente moderado.

Pack 4: Local con Ollama — Costo Cero

Con un NVIDIA DGX Spark (128GB) puedes correr:

| Modelo | RAM | Para qué |

| Gemma 4 26B MoE | 16GB | Tareas rápidas (3.8B activos) |

| Qwen 3.5 72B | 42GB | Coding de alta calidad |

| MiniMax M2.5 | 90GB | Coding SOTA (80.2% SWE-Bench) |

Estrategia: Local primero → fallback a OpenRouter cuando local está ocupado.

Cuál Pack Elegir

| Si eres… | Elige… |

| Emprendedor con presupuesto ajustado | DeepSeek V3.2 (pay-as-you-go) + Ollama local |

| Founder que automatiza su startup | MiniMax Agent Pro ($19/mes) |

| Desarrollador que construye agentes | MiniMax M2.5 local + OpenRouter backup |

| Investor/mentor con poco tiempo | Gemini 2.5 Flash Lite (velocidad > profundidad) |

Conclusión

El benchmark de Abril 2026 confirma lo que ya sospechábamos:

1. DeepSeek V3.2 es el mejor valor absoluto — mejor que modelos 17x más caros

2. GPT-5.4 Mini reemplazó al GPT-5.4 como la mejor opción de OpenAI

3. MiniMax M2.7 es la mejor suscripción fija para agentes

4. Claude ya no justifica su costo para la mayoría de los casos de uso

Si estabas usando Claude porque «era el mejor», es hora de probar DeepSeek o MiniMax. El mercado cambió, los benchmarks demuestran que hay opciones mejores y más baratas.

Metodología: 27 tests ejecutados desde Santiago, Chile, el 11 de Abril de 2026. Tests incluyen content generation, tool calling, task management, code generation, reasoning, summarization, presentation, startup content, image generation y TTS.

🚀 ¿Te interesa la tecnología que realmente importa?

En la comunidad compartimos herramientas, workflows y automatizaciones que usamos en el día a día. Sin teoría — pura práctica.

👥 Entrar a la comunidad