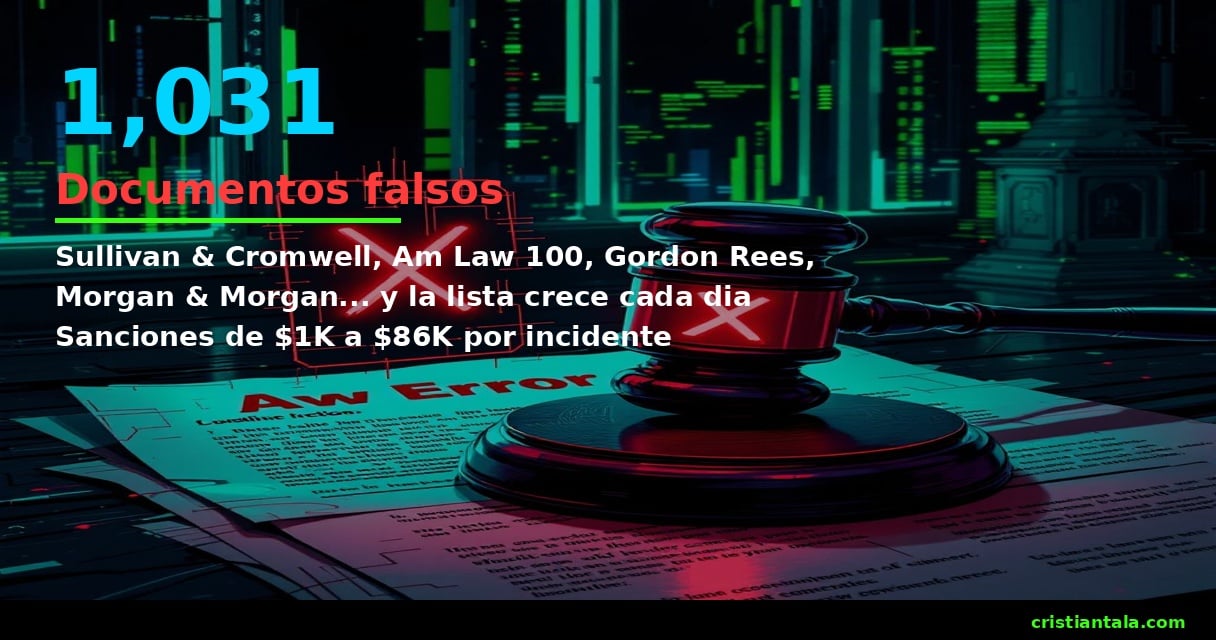

Cuando la IA Alucina: De Wall Street a Latinoamérica — 1,031 Documentos Falsos y la Firma que Representa a OpenAI Cayó También

La firma de élite Sullivan & Cromwell (que representa a OpenAI) presentó un documento judicial con citas inventadas por IA al juez. Tuvo que pedir perdón por carta. No es un caso aislado: 1,031 documentos con alucinaciones de IA documentados hasta marzo de 2026. Sanciones de $1K a $86K. Y mientras en Chile entra en vigencia la ley de protección de datos, los abogados siguen usando IA como si fuera Google.

El caso de la semana: la firma de OpenAI metiendo la pata con IA

El 21 de abril de 2026, Andrew Dietderich — co-jefe del grupo de reestructuración global de Sullivan & Cromwell, una de las firmas de derecho corporativo más prestigiosas de Wall Street con más de 900 abogados — le escribió una carta al juez federal Martin Glenn en Nueva York.

El tono: pedir perdón.

🚀 ¿Te interesa la tecnología que realmente importa?

En la comunidad compartimos herramientas, workflows y automatizaciones que usamos en el día a día. Sin teoría — pura práctica.

👥 Entrar a la comunidad«Lamento profundamente que esto haya ocurrido. Me disculpo en nombre de nuestro equipo completo.»

¿Por qué? Porque Sullivan & Cromwell — la misma firma que representa a OpenAI — presentó un documento judicial en un caso de alta visibilidad con:

- Citas a casos inexistentes inventadas por IA

- Código de quiebras estadounidenses mal citado

- Conclusiones de otros casos resumidas incorrectamente por IA

Los errores fueron descubiertos no por el juez ni por la propia firma, sino por Boies Schiller Flexner, el equipo legal contrario. Y cuando se los señalé, Sullivan & Cromwell tuvo que presentar una versión corregida y admitir que «las políticas de IA de la firma no fueron seguidas y el proceso de revisión secundaria tampoco identificó las citas inexactas generadas por IA.»

La ironía no necesita más explicación.

Pero esto no empezó ayer. Empezó hace 3 años — y ya tiene 1,031 casos documentados

El primer caso que saltó a la fama fue Mata v. Avianca en 2023 ante el Distrito Sur de Nueva York. Los abogados del demandante presentaron un documento con 6 casos completamente inventados por ChatGPT. El abogado dijo ante el juez que pensaba que ChatGPT era «un super motor de búsqueda».

Sanción: $5,000.

Desde ese día, la lista no hace más que crecer. Según la base de datos de Damien Charlotin, que rastrea cada caso documentado de alucinación de IA en documentos legales:

Hasta marzo de 2026: 1,031+ casos documentados a nivel global.

NexLaw AI Hallucination Sanctions 2026

La aceleración es brutal:

- Diciembre 2025: 51 casos con abogados implicados en un solo mes

- Enero 2026: 36 casos

- Febrero 2026: 33 casos (parcial)

Eso es más de un caso nuevo por día, y ni siquiera contamos los que no llegaron a la sanción formal — solo los que fueron documentados públicamente.

Los números que duelen

Sanciones por alucinación de IA en documentos legales (2023-2026)

| Caso | Fecha | Sanción | Qué pasó |

|---|---|---|---|

| Mata v. Avianca | Jun 2023 | $5,000 | 6 casos inventados por ChatGPT. El caso que empezó todo |

| Mostafavi | Sep 2025 | $10,000 | 21 de 23 citas en un brief fabricadas por ChatGPT. El abogado dijo «no sabía que ChatGPT agregaba citas» |

| Morgan & Morgan | 2025 | $5,000 | La firma de 900 abogados. Su plataforma interna de IA alucineó. Tuvieron que retirar mociones |

| ByoPlanet v. Johansson | Ago 2025 | $86,000 | La sanción más alta hasta la fecha. Reuso sistémico de IA a pesar de advertencias previas |

| Fletcher v. Experian | Feb 2026 | $2,500 | 16 citas fabricadas + 5 representaciones falsas. El Quinto Circuito publicó la opinión como advertencia |

| Cassata v. Macrina | Feb 2026 | $10,000 | Citas generadas por IA + plagio de un brief de terceros. El juez creó una tabla de sanciones específica para IA |

| Gordon Rees Scully | 2025-2026 | Múltiples | Firma Am Law 100 sancionada dos veces en casos separados. Política de IA corporativa no sirvió de nada |

| Sullivan & Cromwell | Abr 2026 | Pendiente | La firma que representa a OpenAI. Citas incorrectas + código mal citado en caso de quiebras |

Fuente: NexLaw Sanctions Report 2026, Drug & Device Law / Charlotin Database

128+ abogados individuales implicados solo en Estados Unidos.

Y esto no es solo Estados Unidos. Bloomberg Law reportó en febrero de 2026 que la proliferación de alucinaciones en documentos judiciales «ha impuesto costos sustanciales al sistema judicial» y abogó por reportes obligatorios de sanciones relacionadas con IA.

Por qué la IA inventa casos (y por qué todos caen)

No es que los abogados sean tontos. El problema es más profundo:

1. ChatGPT, Claude y Gemini no son bases de datos legales. Son modelos de predicción de texto. No tienen acceso a Westlaw, LexisNexis ni a ningún sistema judicial. Lo que hacen es generar texto que parece una cita legal porque el formato (nombre del caso, volumen, reporter, página) es altamente predecible.

2. La «trampa de confianza»: el output de IA es indistinguible de una cita real para un abogado que no la verifique. No hay marca de agua ni nota que diga «esto es inventado». Se ve perfecto.

3. Cuanto más difícil es tu argumento, más alucina el modelo. Damien Charlotin lo resumió así: «Cuanto más difícil es tu argumento legal, más tiende el modelo a alucinar, porque intentará complacerte.»

4. Y hasta las herramientas de IA legal especializada alucinan: Investigación de Stanford/Yale (Dahl et al., 2024) encontró que incluso herramientas RAG diseñadas específicamente para derecho alucinan entre 17% y 34% de las veces.

5. El Quinto Circuito de EE.UU. lo dijo directamente en la opinión de Fletcher: «Si la respuesta de un LLM a una consulta parece ‘demasiado buena para ser verdad’ — que un caso o dos son inusualmente útiles o proporcionan una cita que es increíblemente precisa — probablemente, de hecho, es demasiado buena para ser verdad.»

Y esto no es solo un problema de abogados

Si un sistema legal con revisiones múltiples, políticas corporativas de IA, entrenamiento, y 900 abogados termina presentando documentos con citas inventadas, ¿qué pasa con el emprendedor que le pide a ChatGPT que le redacte un contrato?

O el que genera una propuesta comercial con IA y no verifica los datos.

O el que usa un agente para responder comentarios de clientes y el agente inventa una promesa que la empresa no puede cumplir.

El problema no es la IA. El problema es confiar en un modelo probabilístico donde necesitas determinismo. Y eso lo dijimos hace dos semanas en el post De cada 10 Proyectos de Agentes IA, 4 se Cancelan antes de Escalar. La diferencia es que aquí el costo no es solo dinero — es tu reputación, tu caso, y potencialmente sanciones directas.

Chile y la nueva ley de protección de datos

En diciembre de 2026, entra en vigencia la nueva ley de protección de datos personales en Chile. Si tu empresa usa IA para procesar datos de clientes, generar documentos legales, o tomar decisiones automatizadas, necesitas entender esto antes de que entre en vigor.

Porque si tu sistema de IA alucina — ya sea con datos falsos, con información de clientes errónea, o con decisiones automatizadas incorrectas — no solo estás enfrentando un problema de imagen. Estás enfrentando un problema regulatorio.

Y no es hipotético: la AEPD en España ya multó a empresas por decisiones automatizadas sin supervisión humana bajo el GDPR. Chile va por el mismo camino.

Cómo no ser parte de la estadística

La lección de los 1,031 casos es simple:

1. No uses IA generativa para hechos, datos o citas. Úsala para estructura, tono, organización — no para contenido factual.

2. Verifica siempre contra la fuente primaria. Si la IA cita un caso, búscalo en la fuente original. Si te da un número, confirma que existe. Si genera un contrato, revísalo cláusula por cláusula.

3. No confíes en la «política de IA» de tu empresa. Gordon Rees tenía una. Sullivan & Cromwell tenía una. Morgan & Morgan tenía una plataforma interna con presupuesto de IA. Ninguna de las tres sirvió para evitar el error.

4. Documenta tu proceso de verificación. Cuando el juez de Fletcher redujo la sanción de $2,500 a una advertencia, fue porque el abogado admitió el error inmediatamente. Los que mienten o niegan el uso de IA reciben sanciones exponencialmente peores.

5. Y la más importante: si no puedes explicar cómo llegaste a un dato que tu IA te entregó, no lo uses. Punto.

Mi experiencia con esto

Cuando construyo mis propios flujos — en n8n, en OpenClaw, en los agentes que manejan mi ecosistema — la regla es una sola: la IA entiende, el código ejecuta.

Si un agente necesita buscar información, no le pido que recuerde — le doy una herramienta que consulte una API real. Si necesita generar contenido, le doy un fact-check contra la fuente original. Si necesita responder un comentario, le doy el contexto de lo que realmente dije, no lo que «cree» que dije.

Porque cuando la IA alucina, no es un bug. Es feature del modelo. Y tratar una probabilidad como si fuera un hecho — eso sí es un error humano.

Fuentes: The Guardian — Sullivan & Cromwell AI Hallucinations (22 Abr 2026), NexLaw — AI Hallucination Sanctions 2026 (1,031+ casos documentados), LegalTek/Charlotin — PDF de sanciones en archivos judiciales, Bloomberg Law — Spread of AI Hallucinations (Feb 2026), GAICC — What Every Lawyer Must Know about AI Risk 2026, Suprmind — AI Hallucination Statistics Research Report 2026.

🚀 ¿Te interesa la tecnología que realmente importa?

En la comunidad compartimos herramientas, workflows y automatizaciones que usamos en el día a día. Sin teoría — pura práctica.

👥 Entrar a la comunidad